はじめに

生成AIのリスクって、不安で心配になりますよね。

そんな生成AI活用の不安を一瞬で解決できる方法があります。

今回は、生成AIのリスク対策を企業が安全に活用するための完全ガイドをご紹介します。

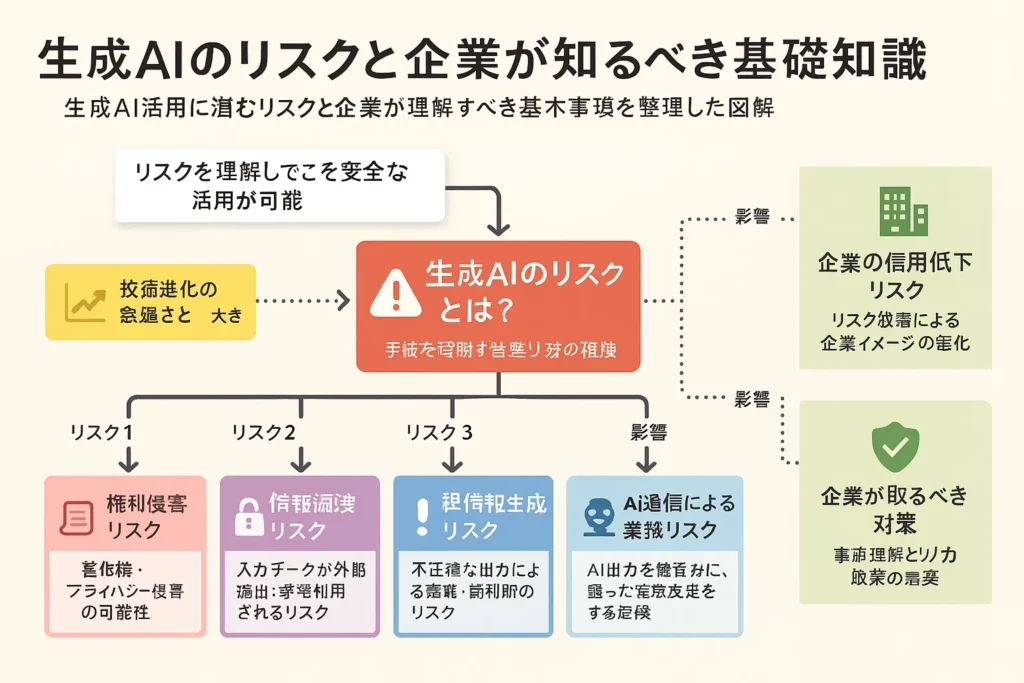

生成AIのリスクとは?企業が知っておくべき基礎知識

生成AIは、今や業務の効率化や新たな価値創出に欠かせないツールとなりました。

しかし、その一方で、企業が見逃してはいけない重大なリスクも潜んでいます。

生成AIのリスクを理解することは、安全かつ効果的なAI活用の第一歩です。

まず、生成AIのリスクが注目されている背景には、急速な技術進化と社会的影響の大きさがあります。

2022年以降、ChatGPTをはじめとする生成AIが急激に普及し、ビジネスシーンでも活用が進む中で、著作権やプライバシー侵害、誤情報の流布といったトラブルが増加しています。

これらのリスクは、企業の信用低下や法的責任の発生といった深刻な問題を引き起こす可能性があるため、事前の理解と対策が不可欠です。

具体的には、生成AIの「学習元データ」に関する問題があります。

AIはインターネット上の大量のデータを学習して文章や画像を生成しますが、その中には著作権で保護された作品や個人情報が含まれていることがあります。

これにより、AIが生成したコンテンツが他人の著作権やプライバシーを侵害するリスクが生じるのです。

例えば、AIに商品説明を作らせた結果、他社のサイトからコピーされたような文章が生成されてしまい、後で権利侵害を指摘されるケースもあります。

また、生成AIはセキュリティリスクも抱えています。

AIの仕組み上、入力したデータが意図せず学習に利用されたり、外部に流出したりする可能性があります。

特に企業内でAIを利用する場合、顧客情報や機密情報が誤って流出するリスクは常に存在しています。

さらに、AIに過度な信頼を置くことによる業務リスクも見逃せません。

生成AIはあくまで予測と推測に基づく出力を行うため、誤った情報や不正確な内容を生成することがあります。

これをそのまま業務に反映すると、誤情報の拡散や意思決定の誤りを招く可能性があります。

特に法務や医療、金融など、正確性が求められる分野では、AI出力の正確性を人間が必ず確認する仕組みが求められます。

このように、生成AIの活用には大きな利点がある一方で、権利侵害、情報漏洩、誤情報生成といったリスクが存在します。

これらのリスクを理解し、適切な対策を講じることが、安全な生成AI活用のための基本です。

- 生成AI:大量のデータを学習して、テキストや画像、音声などを生成する人工知能の一種。

- 学習元データ:AIが学習に使用する情報の集合。著作物や個人情報が含まれる可能性がある。

- セキュリティリスク:データの漏洩や外部からの不正アクセスなど、情報の安全性が脅かされるリスクのこと。

- 誤情報:事実と異なる内容の情報。AIが予測に基づいて生成する場合、誤情報が含まれることがある。

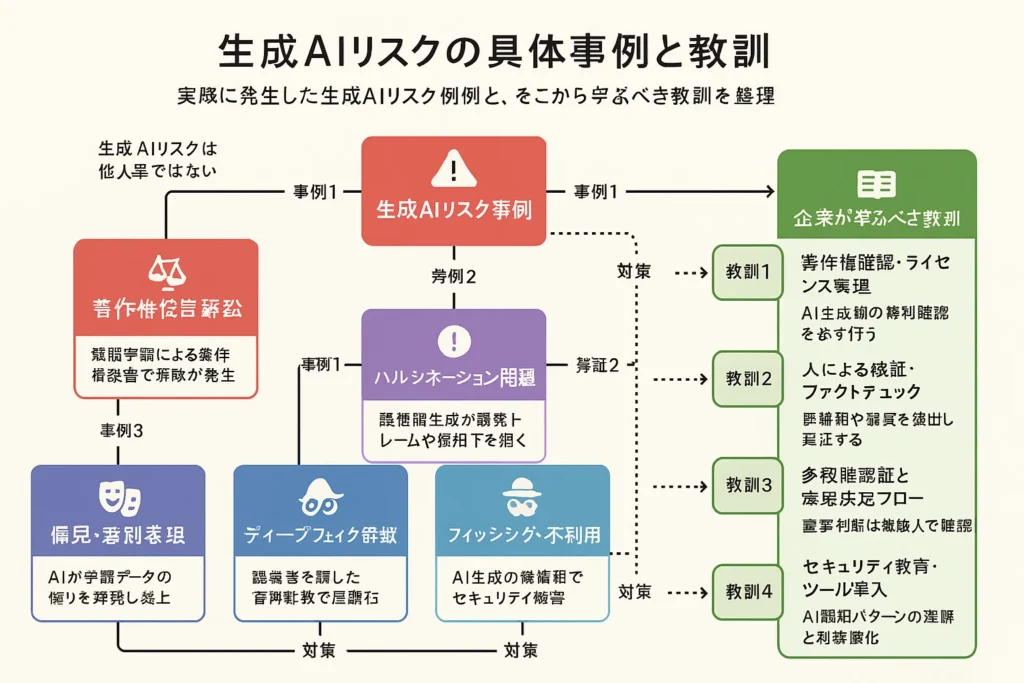

実際にあった生成AIリスクの具体事例と教訓

生成AIのリスクは、単なる理論上の話ではありません。

実際に、企業や個人が生成AIを利用したことでトラブルや損害を被った事例が複数報告されています。

ここでは、代表的な事例を紹介し、そこから得られる教訓を解説します

著作権侵害の訴訟事例から学ぶべきこと

2023年には、米国で著名な作家やアーティストが、自身の著作物が無断でAIの学習に使われたとしてOpenAIやMetaを訴える事例が発生しました。

これは、生成AIが著作物を無断で学習に利用することで、著作権を侵害するリスクが現実に存在することを示しています。

企業がAIを利用する際は、AIが生成したコンテンツが第三者の著作権を侵害していないかを必ず確認し、必要に応じて引用元の明記や適切なライセンス管理を行う必要があります。

ハルシネーション問題と誤情報による混乱

生成AIは事実と異なる内容を生成してしまう「ハルシネーション(幻覚)」現象を引き起こすことがあります。

例えば、企業が生成AIに商品説明やFAQの自動生成を依頼した際、誤った情報が含まれてしまい、顧客からのクレームにつながった事例があります。

このような誤情報は、企業の信頼を損ねる大きなリスクとなるため、生成されたコンテンツは必ず人間の目で検証し、ファクトチェックを行う体制が必要です。

AIが生み出す倫理的課題と社会的リスク

生成AIは、学習データに含まれる偏見や差別的な表現を引き継いでしまうことがあります。

例えば、過去のニュースデータを学習したAIが、性別や人種に基づく偏見を含む文章を生成してしまい、企業の広報活動で使用した際に炎上した事例も報告されています。

こうした問題を防ぐためには、AIに学習させるデータのクリーニングや、生成されたコンテンツの倫理的なレビューを行う体制が求められます。

ディープフェイクによる詐欺と企業被害

生成AIの技術は、ディープフェイクによる詐欺にも悪用されています。

実際に、英国の企業で経営者がAI音声を使った詐欺電話に騙され、数千万円を送金してしまった事件が発生しました。

この事例は、AIが生成するリアルな音声や映像が、ビジネス上の判断を誤らせるリスクがあることを示しています。

特に重要な意思決定を行う際には、複数の確認プロセスを設け、信憑性を確認する手順を徹底することが必要です。

AIの不正利用によるセキュリティ事故

AIを活用したフィッシングメールや偽情報の拡散は、企業の情報セキュリティにとって深刻な脅威です。

実際、AIを活用したフィッシングメール攻撃が大規模に行われた結果、多数の企業が不正アクセス被害を受け、機密情報の流出や業務停止に追い込まれた事例もあります。

このようなリスクに備えるためには、AIを悪用した攻撃のパターンを理解し、社内教育やセキュリティツールの導入を徹底することが重要です。

これらの事例は、生成AIのリスクが現実の問題であることを示しています。

企業としては「起こりうるリスク」を他人事とせず、実際に起きたトラブルを教訓として、自社のリスク対策に活かすことが必要です。

- ハルシネーション:AIが事実とは異なる内容を生成する現象。学習データの偏りや推論ミスが原因。

- ディープフェイク:AI技術を利用して、本物と見分けがつかないほど精巧な偽の音声や映像を作成する手法。

- フィッシングメール:正規の企業や団体を装って送られる詐欺メールで、個人情報や金銭をだまし取る手法。

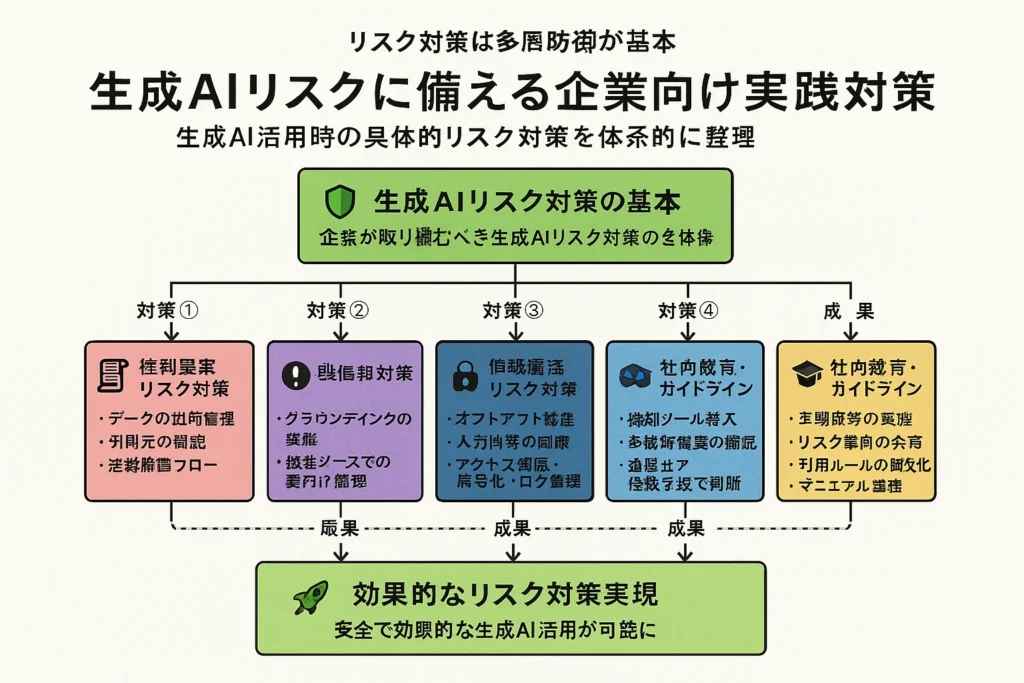

生成AIリスクに備えるための企業向け実践対策

生成AIを安全かつ効果的に活用するためには、リスクに対する具体的な対策が不可欠です。

ここでは、企業が今すぐ実践できるリスク対策の基本と実践ポイントを解説します。

権利侵害リスクの予防法とデータ管理の工夫

生成AIを使用する際には、著作権や商標権などの知的財産権を侵害しないよう注意が必要です。

そのためには、AIに学習させるデータや生成されたコンテンツの出所を明確にし、必要に応じて引用元を明記する仕組みを整えることが重要です。

また、生成AIによるコンテンツは、必ず人間がチェックを行い、外部公開する前に問題がないかを確認するフローを社内で構築しましょう。

例えば、マーケティング資料を作成する場合、AIが生成した文章や画像を法務部門が事前に確認する手順を設定することが効果的です。

AIの誤情報出力を防ぐための運用ルール

生成AIの「ハルシネーション」による誤情報の出力を防ぐためには、AIが参照するデータソースの信頼性を高める「グラウンディング」を実施することが有効です。

具体的には、AIが使用するデータベースを限定し、信頼できる情報源のみを指定することで、出力結果の精度を向上させます。

また、生成された情報は、複数の信頼できるソースで裏付けを取り、事実確認を徹底する運用ルールを作成することが重要です。

特に、医療、法務、金融といった高リスク領域では、このような検証プロセスを標準化する必要があります。

社内データの安全性を守るためのセキュリティ対策

生成AIの利用には、社内の機密情報や個人情報が誤って外部に漏洩するリスクが伴います。

このリスクを防ぐためには、まず生成AIツールの「オプトアウト設定」を有効にし、学習データに自社の情報が使用されないように設定することが基本です。

また、AIへの入力内容を制限し、機密情報や個人情報はAIに入力しない運用ルールを徹底することも重要です。

さらに、社内ネットワークにおけるアクセス制限や暗号化、ログ管理の強化も併せて実施し、情報漏洩のリスクを最小限に抑えます。

ディープフェイク検知ツールの活用法と限界

ディープフェイクによる詐欺被害を防ぐためには、検知ツールの活用が有効です。

たとえば、MicrosoftやMetaが提供するディープフェイク検知ツールを導入し、社内で受け取る映像や音声データに対して真偽確認を行う体制を整えます。

ただし、ディープフェイク検知ツールは万能ではなく、技術の進化により巧妙な偽造コンテンツが作成されるリスクがあるため、最終的には複数の確認手段を組み合わせて判断する必要があります。

リスク対策は多層防御の視点で捉え、1つのツールや手段に過信しないことが重要です。

社内教育とガイドライン作成の重要性

最後に、最も重要なのは従業員一人ひとりが生成AIのリスクを正しく理解し、安全な利用方法を身につけることです。

そのためには、生成AIの利用に関する社内研修を定期的に実施し、AIの仕組みやリスク、最新の事例を共有する場を設けましょう。

加えて、企業としての生成AI利用に関するガイドラインを整備し、著作権やセキュリティ、倫理的配慮についてのルールを明文化することが大切です。

「何をしてはいけないか」「どのような確認が必要か」を具体的に示したマニュアルを作成し、従業員が迷わず安全にAIを活用できる環境を整えましょう。

これらの対策を実践することで、生成AI活用のリスクを大幅に低減し、安全で効果的なAI活用が可能になります。

- オプトアウト設定:AIツールが学習に使用するデータから自社データを除外する設定。

- グラウンディング:AIが生成する回答に対して、指定した信頼できる情報源に基づくよう制限する方法。

- 多層防御:複数の防御手段を組み合わせ、1つの弱点が突破されても全体が破られないようにするセキュリティ戦略。

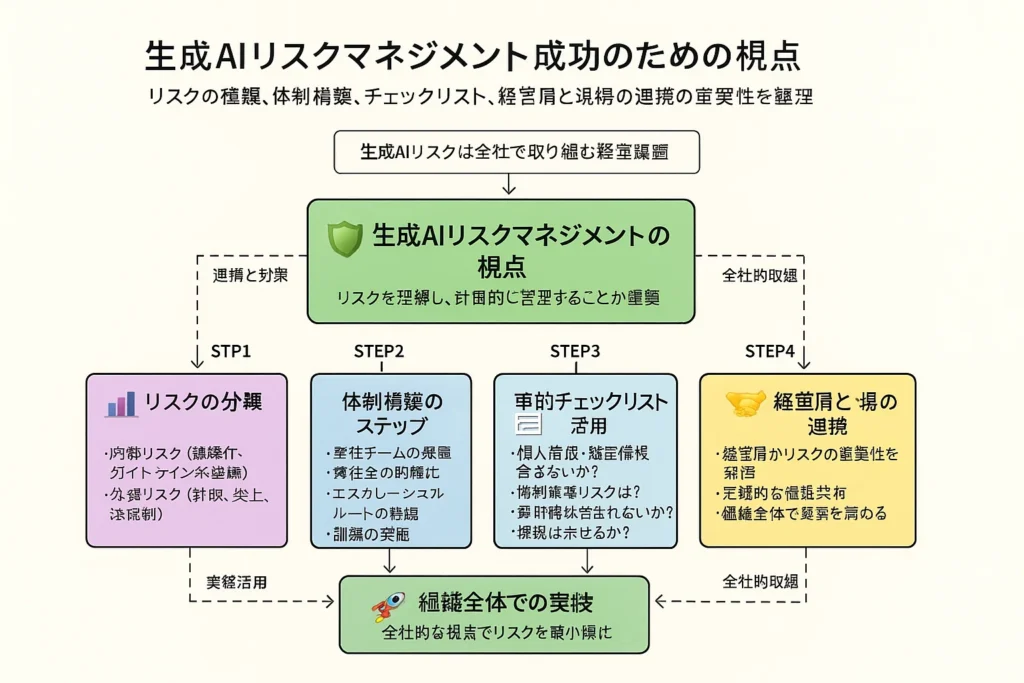

生成AIリスクマネジメントを成功させるための視点

生成AIのリスクを完全にゼロにすることは不可能です。

しかし、企業が正しい視点でリスクを理解し、計画的なマネジメントを行うことで、リスクを最小化しながら生成AIのメリットを活かすことができます。

ここでは、生成AIリスクマネジメントの基本的な考え方と実践のポイントを解説します。

内部リスクと外部リスクの違いと分析手法

まず、生成AIに関するリスクは大きく「内部リスク」と「外部リスク」に分けて考える必要があります。

内部リスクとは、企業内部の要因で発生するリスクです。

例えば、従業員の誤操作による情報漏洩、適切なチェックフローの不備による誤情報公開、ガイドラインの未整備などが該当します。

一方で、外部リスクは、企業のコントロール外にある要因で発生するリスクです。

AI技術の悪用(ディープフェイク詐欺やサイバー攻撃)、社会的な批判や炎上、法改正による規制強化などが含まれます。

これらを分けて把握し、リスクの性質と優先度を明確にすることがリスクマネジメントの第一歩です。

リスクマネジメント体制の構築ステップ

企業が生成AIのリスクに適切に対応するためには、専任チームの設置と責任の明確化が必要です。

まず、生成AIを活用する各部門と連携しながら、リスク管理チームを設置します。

その上で、各リスクごとに責任者を明確にし、問題が発生した際の対応フロー(エスカレーションルート)を整備します。

リスク発生のシナリオを想定した訓練(シミュレーション)も定期的に行い、実際のトラブルに備える体制を整えることが重要です。

リスク回避のための事前チェックリスト活用法

リスク管理の実務では、事前チェックリストの作成と運用が効果的です。

例えば、生成AIを使用する際には以下のような項目を確認しましょう。

- 入力内容に個人情報や機密情報が含まれていないか?

- 出力内容に著作権や商標権の侵害リスクはないか?

- ハルシネーションや誤情報が含まれていないか?

- 出力結果を裏付ける根拠は明示できるか?

- 倫理的・社会的に不適切な内容はないか?

このようなチェックリストを作成し、生成AIを活用する全従業員が利用できるようにしておくことで、日常業務の中でリスク回避が習慣化されます。

経営層と現場の連携が必要な理由

生成AIリスクの管理は、現場任せでは成り立ちません。

経営層が生成AIのリスクを正しく理解し、リスク管理の重要性を認識することが不可欠です。

現場が「リスク対策は後回しでいい」と誤解してしまうのを防ぐためにも、経営層自らが「生成AI活用におけるリスクマネジメントは経営課題の一つである」と明確にメッセージを発信する必要があります。

また、経営層と現場の間で定期的に情報共有を行い、最新のリスク事例や法規制情報を共有し合うことで、組織全体でリスクへの感度を高めることができます。

生成AIのリスクマネジメントは、一部の担当者だけではなく、組織全体で取り組むべき経営課題です。

全社的な視点を持ち、具体的な実践に落とし込むことで、リスクを最小限に抑えた安全なAI活用が実現できるのです。

- 内部リスク:企業内部の要因で発生するリスク。人的ミスやガイドライン未整備などが含まれる。

- 外部リスク:企業の管理範囲外で発生するリスク。サイバー攻撃や法改正など。

- エスカレーション:問題が発生した際に、より上位の担当者や責任者に迅速に報告し、対応を求めるフロー。

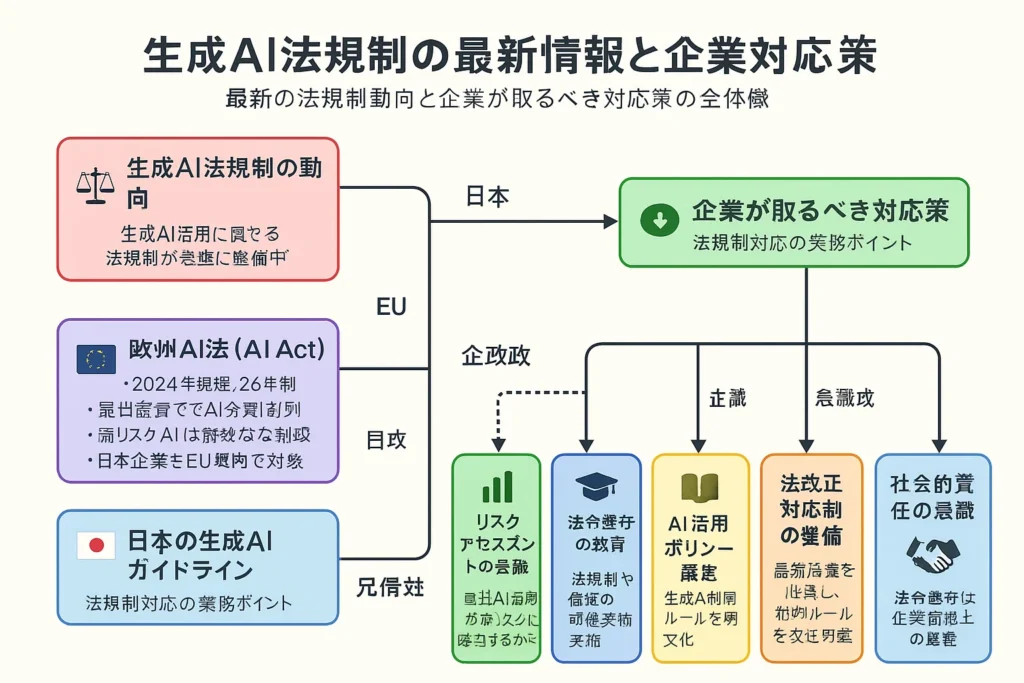

法規制の最新情報と企業が取るべき対応策

生成AIの急速な普及に伴い、各国では法規制の整備が進んでいます。

特に欧州を中心に、企業が生成AIを利用する際の法的責任や運用ルールが明確化されつつあり、日本企業にとっても無視できない動きとなっています。

ここでは、最新の法規制情報と、企業が取るべき実務対応について解説します。

欧州AI法(AI Act)の概要と影響

EUでは、2024年に「AI法(AI Act)」が正式に採択され、2025年以降の全面施行が予定されています。

この法律は「リスクベースアプローチ」を採用しており、AIシステムをリスクの高さによって分類し、特に高リスク領域では厳格な規制が設けられます。

例えば、生成AIを利用して重要な意思決定を行う場合(採用選考、信用スコアの算定、医療診断など)は「高リスクAI」に該当し、事前のリスク評価、透明性確保、説明責任が求められます。

EU域内で事業を展開する日本企業や、EU企業と連携するプロジェクトに参加する企業もこの規制の対象となるため、対応準備は必須です。

日本政府が発表した最新の生成AIガイドライン

日本でも、2024年に総務省とデジタル庁が相次いで生成AIに関するガイドラインを公開しています。

総務省の「情報通信白書」では、AIの信頼性確保や誤情報対策の重要性を強調し、企業に対してセキュリティ対策や倫理的配慮を求めています。

また、デジタル庁の「生成AI利活用ガイドブック」では、生成AIを活用する際の具体的な留意点として、以下のような内容が示されています。

- 出力結果のファクトチェックを必ず行う

- 個人情報や機密情報を含むデータをAIに入力しない

- 出力内容が法令や社会的倫理に反しないか確認する

- プロンプト設計から運用、活用までの各フェーズでの注意点を明記

これらのガイドラインは法的拘束力を持つものではありませんが、企業のリスク管理や社内ポリシー設計の参考資料として重要な役割を果たします。

法規制に対応するための実務対応ポイント

法規制やガイドラインに対応するためには、以下のような実務対応が求められます。

- リスクアセスメントの実施:自社で利用する生成AIが「高リスク」に該当するかを評価し、必要な対策を講じる。

- 法令遵守のための教育:社内でAI活用に関する法規制や倫理的配慮についての研修を実施する。

- AI活用ポリシーの策定:自社の生成AI利用方針を明文化し、従業員が遵守すべきルールを示す。

- 法改正への対応体制の整備:最新の法規制情報を収集し、必要に応じて迅速に社内ルールを改定できる体制を作る。

生成AIを活用する企業は、単に便利さや効率性だけを追求するのではなく、法規制を遵守しながら社会的責任を果たすことが求められています。

これからの時代、法令順守は企業価値を高めるための重要な要素であり、リスク回避のための「守りの戦略」として不可欠な視点です。

- AI法(AI Act):欧州で制定されたAIに関する包括的な法規制。リスクベースでAIの分類と義務を定める。

- 高リスクAI:医療、金融、雇用など社会的影響が大きい分野で利用されるAI。厳格な義務が課される。

- ガイドライン:政府や団体が示す指針。法的拘束力はないが、業界の標準として重要視される。

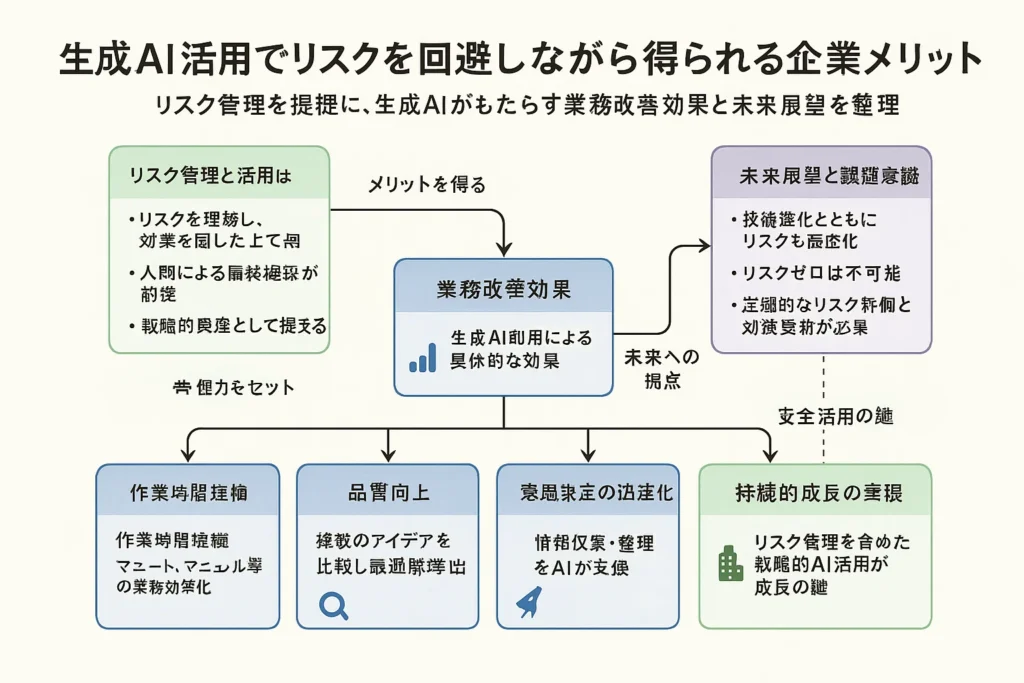

生成AI活用で企業がリスクを回避しながら得られるメリット

生成AIにはリスクが存在する一方で、そのリスクを適切に管理し、安全な運用を実現できれば、企業にとって大きなメリットをもたらします。

リスクを理解し、対策を講じた上で活用することで、生成AIの恩恵を最大限に引き出すことが可能です。

生成AI活用の恩恵を引き出すための考え方

生成AIは、業務の効率化、作業時間の短縮、アイデア創出の支援など、多岐にわたる分野で活用が期待されています。

例えば、マーケティング部門ではコンテンツ作成の時間を大幅に短縮し、法務部門では契約書のドラフト作成をサポートするなど、幅広い業務の効率化が可能です。

また、営業資料の作成や社内マニュアルの自動生成といった用途でも、従来の作業時間を大幅に削減できます。

ただし、これらのメリットを活かすためには「AIが作成したコンテンツは必ず人間が確認する」という運用ルールを徹底し、リスクをコントロールする姿勢が必要です。

安全なAI活用がもたらす業務改善効果

リスク管理を徹底した上で生成AIを導入すると、以下のような業務改善効果が得られます。

- 作業時間の短縮:文章作成やデータ要約、レポート作成などの業務を自動化し、人的リソースを戦略的業務に集中させることが可能になります。

- 品質向上:AIを「アシスタント」として活用することで、複数のアイデアを短時間で比較検討でき、最終的なアウトプットの品質を高めることができます。

- 意思決定のスピードアップ:AIを使って迅速に情報を収集・整理し、経営判断の材料を整えることができるため、意思決定のスピードが向上します。

- 競争力の強化:AIを活用して新しいサービスや製品を開発したり、顧客対応を強化したりすることで、他社との差別化が可能になります。

リスクを理解した上での生成AIの未来展望

今後、生成AIの技術はさらに進化し、業務への活用シーンはますます広がるでしょう。

しかし、その進化とともにリスクも複雑化・高度化していきます。

だからこそ、企業は「生成AIのリスクはゼロにはできない」という前提で、その都度リスクを把握し、対策を更新し続ける姿勢が重要です。

そして、生成AIを単なるツールとしてではなく、「リスク管理を含めた戦略的資産」として捉えることが、今後の企業の競争力を左右します。

リスクを正しく理解し、コントロールした上で生成AIを活用することこそ、企業が持続的に成長していくための新たな武器となるのです。

- 業務改善:既存の業務プロセスを見直し、効率化や品質向上を図る取り組み。

- アシスタント:補助的な役割を持ち、業務を支援する立場。AIは人間のアシスタントとして活用されることが多い。

- 競争力:市場での優位性を高める能力。他社との差別化や独自性が競争力の要素となる。

まとめ

いかがでしたか?

今回は生成AI活用時の落とし穴と企業が取るべきリスク対策ガイドについてご紹介しました。

これで、生成AIの活用に伴うリスクを正しく理解し、適切な対策を講じる方法を把握することができます。

企業として生成AIを導入する際には、リスク管理の意識を高め、安全で効果的な活用を実現するための取り組みを進めていきましょう。

ぜひ参考にしてみてくださいね。